BLOCKDAYS: Jérôme DEROULEZ a participé à la table ronde blockchain et protection des données - Ecole 42 - 12 juin 2018

L'Ecole 42, la faculté de Droit Paris Descartes, IOTA et BCD DIPLOMA ont organisé le 12 juin 2018 les BLOCKDAYS consacré à la blockchain.

Lors de ces travaux, Jérôme DEROULEZ est intervenu avec les professeurs Anne DEBET et Nathalie MARTIAL BRAZ. Cette table ronde portait sur la confrontation entre blockchain et protection des données personnelles. Cette table ronde a suscité de nombreuses questions et interpellations. En effet, plusieurs participants ont fait part des défis posés par la blockchain au regard du cadre juridique applicable aux données personnelles.

BLOCKCHAIN : Audition de Jérôme DEROULEZ dans le cadre de la mission de l'Assemblée nationale

BLOCKCHAIN - Dans le cadre de la mission d’information sur les usages des Blockchains (les chaînes de blocs), présidée par M. Julien AUBERT et ayant comme rapporteurs Mme Laure de la RAUDIERE et M. Jean-Michel MIS, Jérôme DEROULEZ a été auditionné le mardi 17 avril 2018.

Après une brève présentation de l’activité du cabinet, spécialisé dans les nouvelles technologies et tout particulièrement en droit des données personnelles, le cabinet a exposé les enjeux d'une pratique innovante autour de l’accompagnement et du conseil en Blockchain.

A ce titre, le cabinet réalise pour ses clients des études prospectives sur l'environnement juridique et le contexte de l’émergence de la technologie Blockchain afin d'offrir des prestations de conseils et d'accompagnement adaptés.

Le cabinet rédige également des études prospectives sur la Blockchain Stockage des données sur la blockchain : quels enjeux juridiques? mais également dans le domaine des nouvelles technologies - intelligence artificielle (IA émotionnelle), objets connectés etc...

Lors de cette audition, de nombreux thèmes ont été abordés et notamment les liens entre la protection des données personnelles et la Blockchain, la remise en cause ou non du droit des contrats ou des concepts du droit international privé.

Le cabinet reste à votre dispositionpour toute demande de conseil et d'accompagnement de vos projets Blockchain.

RGPD: Jérôme DEROULEZ a participé au numéro spécial COMMUNICATION COMMERCE ELECTRONIQUE dédié au RGPD

RGPD: Jérôme DEROULEZ a rédigé un article consacré aux autorités de contrôle en droit des données personnelles. http://www.lexiskiosque.fr/catalog/communication-commerce-electronique/communication-commerce-electronique/n4-2018

Cet article a été publié dans le numéro spécial COMMUNICATION COMMERCE ELECTRONIQUE consacré au RGPD.

Ce numéro avait pour vocation de balayer les problématiques de la protection des données avant l'entrée en application du règlement.

Stockage de données sur la blockchain: quels enjeux juridiques?

Stockage de données sur la blockchain: quels enjeux juridiques?

Plusieurs articles ont récemment fait état de la découverte sur la blockchain bitcoin de plusieurs fichiers contenants des liens vers des fichiers pédopornographiques.[1] [2]

Tous ces articles font référence à l’étude menée par la « Communication and Distributed Systems RWTH de l'Université d'Aix la Chapelle et par le «Data Protection Research Institue, Goethe University, de Francfortdisponibleici [3].

Pour la résumer rapidement, cette étude souligne les conséquences du stockage de fichiers « non-financiers » sur la blockchain. En effet, selon les auteurs, il serait possible de stocker des contenus illicites, notamment sur la blockchain "bitcoin" et d'engager ainsi potentiellement la responsabilité des acteurs qui y interviennent.

Les auteurs relèvent ainsi :

«Les blockchains permettent principalement une comptabilité crédible du numérique des événements, par exemple des transferts d'argent dans des crypto-monnaies. Cependant, au-delà de ce but initial, les blockchains enregistrent également irrévocablement des données arbitraires, allant des messages courts aux images.

Cela n’est pas sans risques pour les utilisateurs car chaque participant doit répliquer localement la blockchain complète, en y incluant un contenu potentiellement dangereux. Nous fournissons la première analyse systématique des avantages et des menaces pour la blockchain de ces contenus arbitraires.

Notre analyse montre que certains contenus, par exemple en matière de pornographie illégale, peut rendre la simple possession d'une blockchain illégale.[4]

Basé sur ces aperçus, nous effectuons une analyse quantitative et qualitative approfondie de contenus non intentionnels sur la blockchain "bitcoin".

Bien que la plupart des données proviennent d'extensions bénignes au protocole bitcoin, notre analyse révèle plus de 1600 fichiers sur la blockchain, dont plus de 99% sont des textes ou des images.

Parmi ces fichiers, il y a des contenus clairement répréhensibles comme des liens vers des contenus pédopornographiques, qui sont distribués vers tous les participants à cette blockchain "bitcoin".

Avec notre analyse, nous soulignons ainsi l'importance pour l'avenir de la blockchain de répondre à la possibilité d'insertion de données involontaires et d'en protéger ses utilisateurs en conséquence. »[5]

Cette étude vient ainsi à l’encontre d’une idée reçue selon laquelle la blockchain bitcoin serait totalement sécurisée et ouvre des perspectives de réflexions juridiques dans ce cadre, au vu des usages pouvant être fait de la possibilité de stocker des contenus ou des données arbitraires (arbitrary data) sur une blockchain (autres que les contenus liés à des transactions).

Après avoir exposé brièvement les différentes techniques qui permettent de stocker des données non financières (partie 1), nous essayerons de formuler les enjeux de l’insertion de ces données comme les contours de leur appréhension juridique à ce stade (partie 2).

Partie 1. Le stockage de données arbitraires: quelles méthodes?

A l’origine, la blockchain "bitcoin" était notamment destinée à fournir un "enregistrement" pour des transactions financières. D’autres blockchains, comme Ethereum, ont été pensées pour y inscrire d'autres types de données et notamment pour conclure des smart-contrats.

Les résultats de l'étude évoquée plus haut soulignent que la part de données non financières reste très limitée. En effet, l'article indique que seulement 1,4% des 251 millions de transactions sur la blockchain "bitcoin" incluent des données arbitraires:

“In total, our detectors found 3 535 855 transactions carrying a total payload of 118.53 MiB, i.e., only 1.4 % of Bitcoin transactions contain non-financial data. »

Les transactions non-financières ne représentent donc qu’une part très marginale des transactions.

A) Cette étude évoque (page 3) les différentes méthodes d’insertion de données non-financières

(1) Les méthodes d'insertion de données de bas niveau « low-level data Insertion methodes »

OP-RETURN : possibilité d’insérer des données financières, limité à 80B par transaction.

COINBASE : seuls les mineurs peuvent insérer de petits morceaux de données

NON-STANDARD TRANSACTIONS

STANDARD FINANCIAL TRANSACTIONS

(2) Les méthodes de services d’insertion de contenu

Ces méthodes permettent d'insérer des données comme des documents ou des images dans la blockchain, en utilisant différents protocoles:

CryptoGraffiti (ajout de contenu à travers une simple transaction)

Satoshi Uploader (insertion de données avec un champ de longueur et une somme de contrôle spécifique pour en faciliter le décodage)

P2SH Injectors (légère modification de l'écriture des Pay-to-Script-Hash)

Apertus (fragmentation de contenu à travers un grand nombre de transactions, en utilisant un nombre aléatoire d'écritures de transactions Pay-to-Pub-Key-Hash - P2PKH: ces fragments sont référencés dans des archives stockées dans la blockchain qui sera ensuite utilisée pour les ré-assembler).

Ces méthodes traduisent les différentes possibilités d'insérer des contenus "arbitraires" sur la blockchain "bitcoin", depuis les techniques réservées aux seuls mineurs à celles ouvertes à d'autres utilisateurs.

B) L’étude interroge également les bénéfices et les risques liés à l'insertion de contenu arbitraire sur la "blockchain"

(1) Les bénéfices

La blockchain "bitcoin" offre deux canaux d'insertion de "morceaux" de données non financières (OP_RETURN et COINBASE), chaque canal présentant ses bénéfices et ses inconvénients.

OP_RETURN[6] : ce canal permet à quiconque d’insérer des données arbitraires de petites tailles, ce qui peut se révéler très utile avec la possibilité par exemple d’attester de l’existence de documents[7] ou de proposer des services notariaux. Cette fonction est d’ailleurs critiquée puisque la blockchain "bitcoin" n’a pas vocation à devenir une technologie de stockage des données dans un registre distribué[8].

COINBASE : avec cette méthode, seuls les mineurs peuvent ajouter des données non financières aux nouveaux blocs qu'ils minent.

Les bénéfices liés à la possibilité de stocker des données non financières sont nombreux, qu'il s'agisse de l'archivage de données historiques ou de la résistance à la censure. Cependant les conditions du stockage de ces données et leur réplication à tous les utilisateurs de la blockchain peuvent interroger en l'absence de possibilité de le refuser.

(2) Les risques

L’insertion de données non-financières peut présenter des risques pour tous les utilisateurs de la blockchain au vu des différents types de fichiers pouvant être contenus et notamment:

Contrefaçon : une manière de contourner la répression concernant le téléchargement illégal.

Malware : télécharger un virus sur la Blockchain qui pourrait se répandre.

Violation de la vie privée : menaces, chantage, revenge porn...

Contenu politique sensibles : révélations de secrets d’Etats

Contenus illégaux : pédopornographie

Les auteurs de l'étude ont indiqué avoir mis en évidence:

Contrefaçon : 7 fichiers

Des clefs cryptographiques dérobées

Un logiciel aidant à casser les protections anti-contrefaçon de DVD

Violation de la vie privée : photos de mariage, échanges de mails, post, forum de discussion, numéro de téléphone, adresse, compte bancaire...

Contenu politique sensible : lanceurs d’alertes, résistants à la censure...

Contenu illicite : au moins 8 fichiers concernant du contenu sexuel, parmi ces fichiers, 2 d’entre eux contenaient des sauvegardes de liens qui renvoyaient vers de la pédopornographie, contenant 274 liens vers des sites web[9]

Si la majorité des contenus étaient pour la plupart licites, d’autres au contraire sont potentiellement susceptibles de poursuites et les auteurs de l'étude ont recommandé que les [10] « futures conceptions de blockchain doivent faire face pro activement aux contenus répréhensibles ».

A ce titre, ils recommandent un système de "filtrage" des transactions entrantes évolutif et transparent dont les modalités restent néanmoins à fixer.

Ces débats montrent la place grandissante prise par les considérations éthiques au sujet des crypto-monnaies à l’instar de Conscoin qui se présente comme étant une crypto-monnaie éthique.« Cryptocurrency with a Conscience: Using Artificial Intelligence to Develop Money that Advances Human Ethical Values »[11]

Partie 2. Quels enjeux juridiques (responsabilité, qualification pénale, droit international privé)?

Une blockchain est un registre distribué, c'est-à-dire que chaque transaction est validée par les nœuds du réseau. Afin de valider ces transactions, tous les nœuds possèdent, de façon répliquée, cette blockchain.

« En conclusion, un large éventail de contenu répréhensible peut causer un préjudice direct si possédé par les utilisateurs. Contrairement aux systèmes tels que les plates-formes de médias sociaux, réseaux de partage de fichiers, ou des systèmes de stockage en ligne, ce contenu peut être stocké sur blockchains anonymement[12] et irrévocablement. Puisque toutes les données Blockchain sont téléchargées et constamment conservés par les utilisateurs, ils sont responsables de tout contenu ajouté à la Blockchain par d'autres. Par conséquent, il serait illégal de participer à un système basé sur Blockchain dès qu'il contient du contenu illégal. »[13]

En conséquence et de manière très schématique, chaque utilisateur qui aura une "copie" de la blockchain détiendrait donc aussi des fichiers potentiellement illégaux. Voire ne pourrait connaître totalement toutes les informations contenues dans une blockchain.

(A) Retracer l’identité de la personne auteur du fichier illégal : anonymat ou pseudonymat sur la Blockchain ?

Il existe une idée et très souvent partagée sur la blockchain bitcoin, qui serait que toutes les transactions sont parfaitement anonymisées. Or, cette affirmation est à relativiser comme l’ont souligné de nombreuses études (et notamment, notamment « An analysis of Anonymity in the Bitcoin System ») [14].

Il s’agirait plutôt d’un pseudonymat qui permettrait de rattacher la transaction à un individu plutôt qu’un réel anonymat. Les différences entre l’anonymisation et la pseudonymisation sont parfois difficiles à saisir en droit de la protection des données personnelles et le Groupe de travail de l’article 29, dans un avis rendu le 10 avril 2014[15] a présenté à ce titre les différentes techniques d’anonymisation (une donnée anonyme est une donnée qui ne peut être attribuée à une personne identifiée). Or, sur la blockchain bitcoin, il est possible par un faisceau d’indices d’identifier indirectement une personne.

Même si les techniques de « mixage de bitcoin[16] » permettent de disperser plus encore les informations liées à une transaction par exemple, l'utilisation de cette technique a fait débat. Ainsi, certains services de mixage de Bitcoin sont revenus sur leurs positions et indiqué que le mixage de bitcoin était contraire à l’idéologie initiale de la blockchain qui était la transparence et non l’anonymat.

C’est dans cette volonté de transparence qu’ont émergé de nombreux explorateurs de Blockchain comme par exemple le sitehttps://blockchain.info/fr .

La question de l'identification ouvre cependant des champs de recherche et de discussions qui portent aussi bien sur les "valeurs" véhiculées par la blockchain bitcoin notamment (ou d'autres blockchains) que sur les métamorphoses de l'identité.

(B) Quelles responsabilités sur la blockchain bitcoin ?

Dans l’étude précédemment citée, la question de l'insertion de liens renvoyant vers des sites pédophiles et notamment vers le darkweb a été soulignée. La première question à régler sera donc de déterminer qui est le poseur de lien ? Or la question de l’auteur de l’acte sera particulièrement délicate à établir. Pour le moment, il n’y a pas d’obligation de démontrer son identité pour enregistrer des transactions sur la Blockchain même si de potentielles régulations à ce sujet ne sont pas exclues.

Dans l’hypothèse où la personne est identifiable, il est possible de faire l’analogie avec le régime juridique des poseurs de liens hypertextes retenu en matière de contrefaçon. La Cour de justice de l’Union européenne, par une série d’arrêts, a crée de façon prétorienne les critères d’engagement de la responsabilité des poseurs d’hyperliens[17]. Dans le récent arrêt GS Media[18], la CJUE a apporté des éléments de précisions et indiqué pour retenir la contrefaçon qu'il était nécessaire que la personne ait connaissance du caractère illégal de la publication de ces œuvres[19].

Quelle responsabilité pénale pour la personne qui inscrit des données dans une blockchain?

Si la question de la répression pénale de la détention de fichiers pédopornographiques est réglée par le Code Pénal[20] indépendamment de son support (clef USB, disque dur...), celle du stockage de fichiers sur la blockchain interpelle: stocker des fichiers sur la blockchain peut-il être assimilé à une détention au sens du Code Pénal? Se pose aussi la question de la "propriété" de la blockchain dans tous les sens du terme...

La personne peut-elle être sanctionnée sur le terrain de la complicité ?

Un mineur peut-il être poursuivi sur le terrain de la complicité? En effet, selon les techniques utilisées, le mineur pour valider les blocs doit répliquer la blockchain, dans des conditions telles que sa connaissance de l'existence des fichiers illicites sera délicate à établir. Et devra requérir des modalités d'expertise spécifiques. Par ailleurs, plusieurs médias ont également dévoilé que les utilisateurs de certains sites minaient des crypto-monnaie à leur insu ! [21] La question est donc ouverte...

Quels instruments? Ces questions ouvrent la voie à une prospective juridique et débordent très largement les seuls enjeux en matière de données personnelles ou de droit pénal. A ce titre, l'utilisation de la blockchain interpelle les outils existants du droit international privé (quelle loi applicable, quelle juridiction applicable?). En fonction des types de données et de fichiers stockés, de très nombreuses conventions internationales pourraient aussi trouver à s'appliquer comme la Convention internationale de protection de l’enfance[22], les Conventions internationales de protection de la propriété intellectuelle[23], les conventions de protection de la vie privée[24] ou encore le RGPD [25].

Conclusion

Au-delà de cette étude, la question de l’appréhension juridique de la blockchain se fait de plus en plus pressante. A fur et à mesure de sa démocratisation, les questions posées par l'utilisation ou les modes de fonctionnement des blockchains -et notamment de la blockchain bitcoin- interpellent les juristes dans des domaines très différents (droit des données personnelles, droit international privé, droit pénal...) et devront être évoqués ou prises en compte, à défaut d'une régulation globale dont les contours sont difficilement envisageables à ce jour.

[3]https://fc18.ifca.ai/preproceedings/6.pdf

[4] Affirmation à nuancer en raison, comme nous allons le voir, des différentes incertitudes concernant l’appréhension juridique de ce phénomène et les potentiels obstacles juridiques.

[5] Traduit librement depuis l’étude originale en anglais cite précédemment. (Page 1)

[6] Analyse of Bitcoin OP_RETURN metadata

[7] p.5

[8]https://en.bitcoin.it/wiki/OP_RETURN

[9] Page 13

[10] Page 13

[11]https://www.finyear.com/attachment/641777/

Dans cet article, nous contestons une telle présomption que l'argent doit avoir une valeur-neutre. En bâtissant sur les progrès de l'intelligence artificielle, de la cryptographie, et des machines éthiques, nous soutenons qu'il est possible de concevoir des crypto-monnaies artificiellement intelligentes, qui ne sont pas éthiquement neutres, mais qui régulent de manière autonome leur propre usage d'une manière qui reflète les valeurs éthiques de certains êtres humains, ou de sociétés humaines, même entières

[12] Attention toutefois : il s’agit plutôt de pseudonymat que d’anonymat

[13] Page 7

[14] An Analysis of Anonymity in the Bitcoin System Fergal Reid Martin Harriganhttp://fc17.ifca.ai/bitcoin/papers/bitcoin17-final32.pdf

[15]http://www.dataprotection.ro/servlet/ViewDocument?id=1288 et voir aussi la décision du Conseil d’Etat du 8 février 2017

[16]https://cryptoactu.com/cryptomonnaies/plus-gros-service-de-mixage-de-bitcoin-monde-ferme-portes/

[17] CJUE, 13 février 2014, Svensson, C-466/12

CJUE, 21 octobre 2014, C-348/13

[18]http://curia.europa.eu/juris/document/document.jsf?docid=183124

L’article 3, paragraphe 1, de la directive 2001/29/CE du Parlement européen et du Conseil, du 22 mai 2001, sur l’harmonisation de certains aspects du droit d’auteur et des droits voisins dans la société de l’information, doit être interprété en ce sens que, afin d’établir si le fait de placer, sur un site Internet, des liens hypertexte vers des œuvres protégées, librement disponibles sur un autre site Internet sans l’autorisation du titulaire du droit d’auteur, constitue une « communication au public » au sens de cette disposition, il convient de déterminer si ces liens sont fournis sans but lucratif par une personne qui ne connaissait pas ou ne pouvait raisonnablement pas connaître le caractère illégal de la publication de ces œuvres sur cet autre site Internet ou si, au contraire, lesdits liens sont fournis dans un tel but, hypothèse dans laquelle cette connaissance doit être présumée.

[19] La Cour de justice énonce que le caractère lucratif est un indice qui quant à lui permettra au cas par cas de prouver l’intention et la connaissance des conséquences juridiques de l’acte. Mais ce n’est pas pour autant une condition de qualification.

[20] Article 227-23 du code pénal

[22] Protocole facultatif à la Convention relative aux droits de l'enfant, concernant la vente d'enfants, la prostitution des enfants et la pornographie mettant en scène des enfants

http://www.ohchr.org/FR/ProfessionalInterest/Pages/OPSCCRC.aspx

[23] Convention de Berne de 1886 offrant une protection minimale sur tous les Etats signataires

[24]Directive 2013/40/UE du Parlement et du Conseil Européen du 12 aout 2013, relative aux attaques contre les systèmes d’information remplaçant la décision cadre 2005/222/JAI du Conseil.

RGPD : Jérôme DEROULEZ a publié un article sur les responsabilités des maires dans la Gazette des communes d'avril 2018

Interview de Jérome Deroulez dans la Gazette des Communes

«Données personnelles : quelles responsabilités pour les maires ?»

Jérôme Deroulez est revenu sur les obligations qui pèseront sur le maire en matière de protection des données personnelles à compter du 25 mai prochain, date d'entrée en application du RGPD.

« Alors que le Règlement général sur la protection des données personnelles (RGPD) entre en application le 25 mai prochain, le sujet de la préparation des collectivités locales et des communes à ce nouveau dispositif a agité le Sénat lors des débats sur l’adaptation de la loi Informatique et Libertés la semaine dernière.

La rapporteure du texte, Sophie Joissains, a ainsi souligné que seule une minorité de collectivités territoriales était en conformité et signalé la difficulté au vu des enjeux suscités par le RGPD au niveau local.»

Retrouvez l'intégralité de cet article sur le site de la Gazette des communes.

Petites et moyennes entreprises – avez-vous une charte Informatique et Libertés ?

Disposez-vous d’une charte Informatique et Libertés ? Quelles décisions avez-vous prises pour assurer la sécurité des données que vous collectez ou que vous stockez ? La question est d’actualité alors que la vie des entreprises a été marquée en 2017 par plusieurs failles de sécurité et cyber-attaques (Wannacry [1], NotPetya) qui témoignent de la nécessité de former ses équipes et ses salariés à la sécurité des systèmes d’information.

Pourquoi une charte Informatique et Libertés ?

Cette question est cruciale à la veille de l’entrée en application du Règlement général sur la protection des données personnelles qui a fait de la sécurité des systèmes d’information et des données des priorités, le RGPD renforçant par ailleurs les niveaux de sanction applicables.

A ce titre, l’article 32 du RGPD prévoit notamment que le responsable du traitement et le sous-traitant mettent en œuvre les mesures techniques et organisationnelles appropriées afin de garantir un niveau de sécurité adapté au risque, et suggère entre autres de recourir à la pseudonymisation et au chiffrement des données à caractère personnel, aux moyens permettant de garantir la confidentialité, l'intégrité, la disponibilité et la résilience constantes des systèmes et des services de traitement; aux moyens permettant de rétablir la disponibilité des données à caractère personnel ou encore à une procédure visant à tester, à analyser et à évaluer régulièrement l'efficacité des mesures techniques et organisationnelles pour assurer la sécurité du traitement.

Accountability et sécurité des données

Avec la consécration du principe d’accountability, responsables de traitement et sous-traitants devront aussi être en mesure de démontrer qu’ils ont mis en œuvre les mesures nécessaires destinées à assurer la sécurité des traitements. Au-delà des outils énumérés par le RGPD, les chartes Informatique et Libertés sont également un moyen efficace pour les entreprises de démontrer leur conformité tout en favorisant en interne la diffusion de la culture de la sécurité informatique.

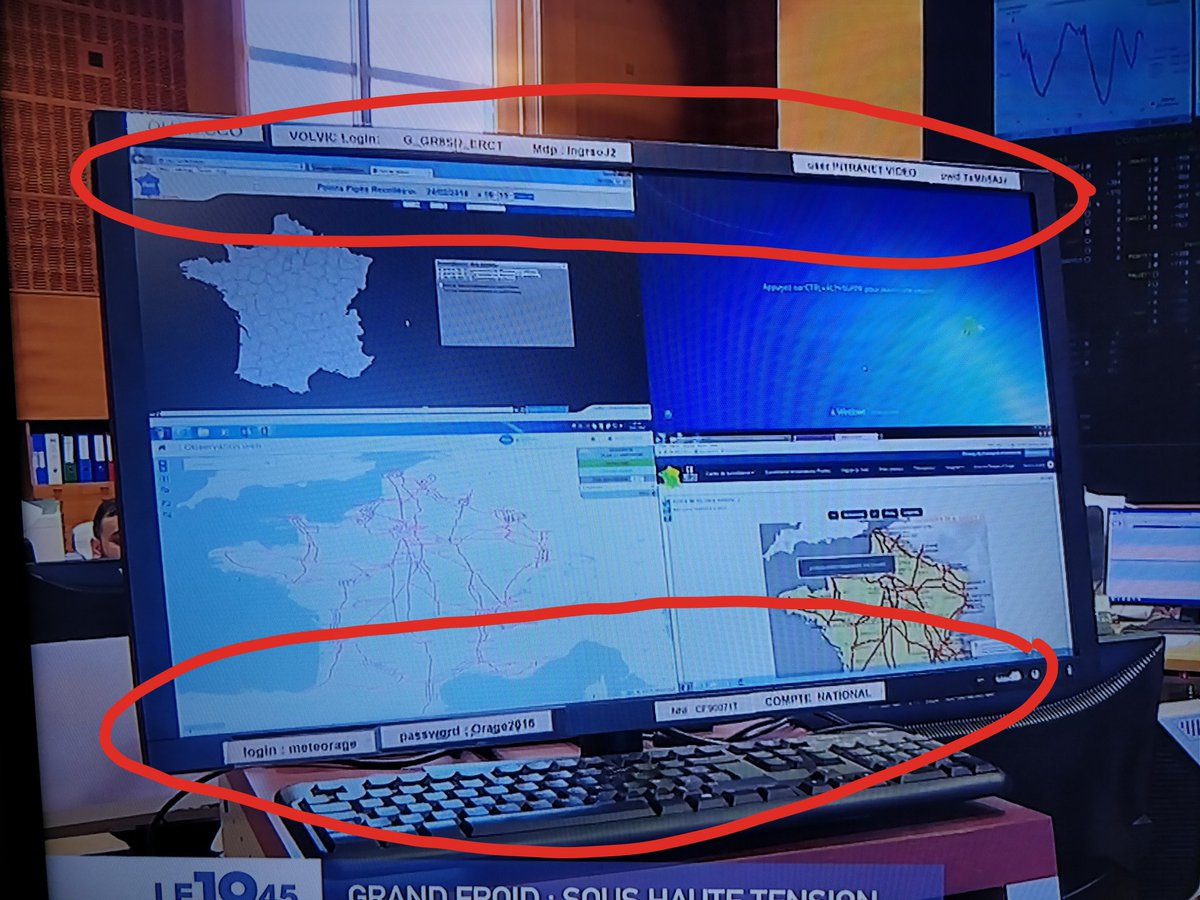

Pourtant, de nombreuses entreprises n’ont pas encore ou peu cette culture de la sécurité de leurs données comme en atteste ce très récent passage diffusé sur le 19h45 de M6 à une heure de grande audience où apparaissaient, visibles en clair à l’écran, différents mots de passe affichés sur le poste du travail d’un salarié d’ENGIE relevé par un compte Twitter.

Était ainsi pointée l’absence de prise de conscience de la protection des mots de passe par un mécanisme adéquat.

Le présent article sera donc l’occasion de rappeler la nécessité et l’intérêt pour les entreprises de disposer d’une charte Informatique et Libertés.

Cette charte devra être annexée au règlement intérieur de l’entreprise afin de la rendre opposable aux salariés et collaborateurs.

Qui met en place la charte Informatique et Libertés ?

C’est l’employeur dans le cadre de son pouvoir de direction et de contrôle qui peut (et le plus souvent qui doit) encadrer l’activité informatique et l’accès à Internet de ses salariés et collaborateurs, dans le respect du droit à la vie privée du salarié[2].

En effet, une telle charte est souvent indispensable et notamment pour encadrer les utilisations à des fins privées de certains sites et éviter de futurs contentieux. Peuvent être ainsi traitées par la charte les questions de la consultations de sites qui seraient expressément interdits par la charte informatique [3],l’installation de logiciels non autorisés[4]la divulgation non autorisée d’informations confidentielles [5]les mesures de sécurité qui doivent être mise en œuvre (chiffrement, sécurisation des mots de passe) etc… Avec en conséquence la nécessité d’énoncer clairement ces bonnes pratiques de sécurité au sein de la charte.

La mise en place de la charte a de multiples intérêts : elle constitue un outil pédagogique utile pour les salariés et collaborateurs, notamment lors de nouvelles embauches. Elle permet aussi de valoriser et de protéger les process mis en œuvre au sein des entreprises en matière de sécurité des données personnelles.

Comment rédiger sa charte informatique et libertés? Nos conseils

Introduction de la charte (Préambule) :

Indiquez en introduction les objectifs de la Charte.

Exposez l’objectif et la portée de la Charte.

Expliciter les attentes de votre entreprise pour faire de la charte un outil de sensibilisation en interne sur les questions de sécurité.

Indiquez des éléments de protection des données personnelles et mentionnez la désignation d’un DPO ou les personnes « contact » utiles

Opposabilité de la charte :

Veillez à énumérer de façon exhaustive tous les personnels et collaborateurs concernés par la charte.

Explicitez les modalités d’information sur la charte (lieux d’affichage, documentation, modalités de prise de connaissance par les salariés et les collaborateurs et de signature etc…)

Définitions :

Les termes utilisés doivent être clairs et précis.

Une attention particulière sera portée à la rédaction de la charte pour en assurer la neutralité technologique à terme afin d’englober de futures innovations technologiques (par exemple la Blockchain ou le recours à l’AI).

Quelles règles d’utilisation du système d’information – usages :

Recensez d’abord l’ensemble des besoins auxquels le système d’information doit répondre.

Répertoriez tous les outils numériques mis à disposition des salariés et collaborateurs.

Définissez une politique de confidentialité des accès et des mots de passe et développez des bonnes pratiques.

Définissez et explicitez les pratiques autorisées (gestion des habilitations, usages et renouvellement des mots de passe, procédures à respecter.

Définissez quelles sont les mesures de sécurité prises afin de sécuriser l’accès aux différents postes dans votre entreprise.

Quelles obligations pour les utilisateurs ?

Rappelez aux utilisateurs qu’ils sont responsables des ressources informatiques qu’ils utilisent.

Rappelez aussi des règles de bon sens (ne pas insérer des clefs UBS étrangères à l’entreprise, pas de communication excessive des données et notamment à des personnes non autorisées...).

Posez des règles claires quant à l’utilisation d’Internet et des outils informatiques de votre entreprise à des fins personnelles.

Définissez des conditions d’utilisation des espaces de stockage ou pour l’installation de logiciels.

Rappelez les conditions d’utilisation de la messagerie électronique de l’entreprise et soulignez la présomption de professionnalité des messages transmis.

Outils de contrôle du poste informatique / surveillance du salarié :

Indiquez quels outils de filtrage sont mis en place.

Explicitez les systèmes de contrôle du salarié et les différentes informations pouvant être enregistrées.

Notez que ces outils de contrôles et de surveillance des salariés devront être proportionnés à l’objectif poursuivi.

Travail à distance et mobilité des salariés :

Prenez en compte la virtualisation ou non des postes de travail avec leurs conséquences (règles d’attribution et d’usages des matériels, tablettes, téléphones et ordinateurs portables).

Posez des règles claires dans les cas de mobilité des salariés et exposez les différentes situations envisageables.

Sanctions :

La charte doit indiquer quelles sont les sanctions prévues.

Elle doit également préciser les conditions d’engagement de la responsabilité civile et pénale des salariés et des collaborateurs ou de procédures disciplinaires.

Entrée en vigueur de la charte :

Précisez la date d’entrée en vigueur de la charte et d’entrée en application.

Mettre les annexes en lien ou notes de bas de page

Annexe - Dispositions légales applicables:

- Loi informatique et libertés

- Code pénal : article 226-16 à 226-24 et R.625-10 à R.625-13

- Loi Godfrain : article 323-1 et 323-3 code pénal

Références:

[2]« Le salarié a droit, même au temps et au lieu du travail, au respect de l'intimité de sa vie privée ». Cour de cassation,Chambre sociale, 2 octobre 2001, n° 99-42.942. Voir arrêts récent sur la labellisation des fichiers indiqués comme privés et le durcissement de la position de la Cour de cassation après le célèbre arrêt Nikon. CEDH, 22 janvier 2018 ; n° 588/13 mettre l’intégralité du Disc dur comme privé « la dénomination donnée au disque dur lui-même ne peut conférer un caractère personnel à l’intégralité des données qu’il contient ; que la cour d’appel, qui a retenu que la dénomination « D:/données personnelles » du disque dur de l’ordinateur du salarié ne pouvait lui permettre d’utiliser celui-ci à des fins purement privées et en interdire ainsi l’accès à l’employeur, en a légitimement déduit que les fichiers litigieux, qui n’étaient pas identifiés comme étant « privés » selon les préconisations de la charte informatique, pouvaient être régulièrement ouverts par l’employeur ; »

[3]CA Grenoble, ch. soc., 16 janv. 2008, n° 07/01119 : la consultation par un salarié de sites pornographiques, expressément interdit par la Charte informatique, le licenciement pour faute grave du salarié est justifié. Voir aussi Cass. soc., 15 déc. 2010, nº 09-42.691.

[4]CA Paris, pôle 6, ch. 5, 19 janv. 2012, no 10/04071, M. Rudy c/ Sté Zétès, en l’espèce un technicien de maintenance avait installé sur son poste de travail des logiciels qui n’étaient pas autorisés par la Charte informatique.

[5]Cass. soc., 5 juill. 2011, n° 10-14.685 la salariée a été licenciée pour faute grave : la salariée avait permis à un autre salarié qui n’y était pas habilité d’utiliser son code d’accès pour télécharger des informations confidentielles.

Sources complémentaires :

https://www.cnil.fr/sites/default/files/typo/document/20100730-MOD-CHARTE_INFORMATIQUE_CIL-VD.pdf

L’intelligence artificielle émotionnelle : quels enjeux pour la protection des données personnelles ?

Lors du dernier Consumer Electrics Show [1]qui s’est tenu en janvier dernier à Las Vegas, le projecteur a été braqué sur l’Intelligence Artificielle et ses applications au quotidien: le rapport exhaustif d’Olivier Ezratty a souligné à juste titre l’émergence de plus en plus forte d’un nouveau genre d’IA, l’IA émotionnelle. A ce titre, plusieurs start-ups ont mis en avant lors de ce CES des projets novateurs en la matière. C’est le cas notamment de :

Emoshape, créée par Patrick Levy-Rosenthal qui a présenté son composant électronique « Emotion Processing Unit » (EPU) destiné à capter les émotions des utilisateurs ». A notamment été mise au point une puce capable de synthétiser douze émotions, 6 positives, 6 négatives.

Beyond Verbal, spécialisée dans la détection des émotions dans la voix.

Batvoice utilisée notamment dans les centres d’appels afin de détecter l’état émotionnel de leurs clients.

Ce qui distinguait jusqu’à aujourd’hui les humains de robots dotés d’intelligence artificielle forte était leur incapacité à ressentir des émotions. Comme le robot Pepper interviewé dans une vidéo du journal Libération [2]« Pepper, peux-tu tomber amoureux ? » auquel il répondit « si je tombe c’est que l’on m’a mal programmé ».

L’enjeu aujourd’hui consiste à doter les robots et les intelligences « artificielles » d’émotions et de sentiments pour leur permettre d’interagir de manière efficace avec les personnes.

Enjeux de l'Intelligence artificielle émotionnelle?

Un robot deviendrait ainsi un être capable de ressentir des émotions, avec au-delà les questions du statut juridique du robot et de sa personnalité juridique avec en filigrane celle de l’homme « augmenté ». Comme l’énonce l’auteur de David Levy, auteur de Love and Sex with Robots, « en 2050, non seulement des individus tomberont amoureux de robots androïdes, mais des mariages entre l’homme et la machine seront célébrés », celui-ci se fondant par exemple sur les nouveaux types de robots sexuels développés aux Etats-Unis.

Ce nouveau genre de robot interpelle sous l’angle de la question de la protection de la vie privée et de la collecte des données personnelles. En effet, à mesure que les interactions avec des robots seront de plus en plus fortes, la masse de données personnelles qui pourrait être collectée et traitée sera considérable à l’image des données générées aujourd’hui par certains objets connectés à usage domestique.

A terme et à travers le recours à des IA émotionnelles, la plupart de nos actions, dialogues, faits et gestes pourraient ainsi être potentiellement stockés dans des serveurs voire retraités, revendus et exploités à d’autres fins. En effet, ces robots d’un nouveau genre et dotés d’intelligence émotionnelle seront programmés pour s’adapter au mieux à leur environnement, grâce à un profilage intense de son environnement (goûts, habitudes de vie, préférences ou réactions…) ce qui impliquera une collecte massive de données personnelles grâce à différents types de capteurs (caméra, micro, biométrie etc...). Et donc des volumes de données sans précédent.

L’intelligence artificielle émotionnelle soulève dès lors de nombreuses questions au vu des frictions éventuelles avec la législation applicable sur la protection des données personnelles.

Ces questions s’adressent aux concepteurs et aux développeurs de telles IA : en effet, la définition et la construction de tels robots implique de prendre en compte à toutes les étapes de leur développement et de leur fonctionnement les principes de privacy by design et de privacy by default ou encore de minimisation de la donnée posés par le RGPD.

Intelligence artificielle émotionnelle et données personnelles

Cette réflexion doit aussi porter sur l’utilisation des données que ces IA vont générer ensuite. Qu’en sera-t-il du stockage des données collectées, de leur traitement et de leur conservation ? Comment l’analyse fine des traits de la personnalité humaine qui est à la base de la conception d’un IA émotionnelle pourra-t-elle être respectueuse du droit fondamental à la protection des données tout en générant des modes de contrôle? Ces questions restent partiellement sans réponse et appellent des développements particuliers, en fonction des technologies développées.

Ces questions ne sont pas éloignées non plus des débats sur le post-humanisme, avec la possible mise en jeu des droits de l’homme par un hypothétique droit des robots.

Alors que l’Union européenne s’engage dans une réflexion juridique et éthique sur l’intelligence artificielle, les avancées de l’IA émotionnelle doivent être pleinement prises en compte à travers les projets concrets mis en place. De la même façon, les acteurs de ce secteur doivent s’impliquer pour une intégration active et efficace des principes applicables en droit de la protection des données. Pour aboutir à des intelligences artificielles respectueuses de la vie privée et génératrice de confiance de la part des usagers et des clients.

Notre cabinet est à votre disposition à Paris et Bruxelles pour évoquer ces questions avec vous.

[1]http://www.oezratty.net/wordpress/2018/rapport-ces-2018/

[2]http://www.liberation.fr/video/2014/09/06/on-a-teste-nao-et-pepper-les-robots-humanoides-qui-vont-revolutionner-nos-foyers_1094573

PROTECTION DES DONNEES PERSONNELLES : QUELLE ACTUALITE EN 2018?

Le droit de la protection des données à caractère personnel a connu une actualité très dense en 2017. 2018 sera marquée par plusieurs étapes importantes, dont l’entrée en application du RGPD en mai prochain et l’adoption rapide de l’adaptation législative de la loi Informatique et Libertés.

Le RGPD n’est cependant qu’une des étapes des chantiers ouvertes dans le domaine de la protection des données. 2018 sera ainsi marquée par de nouvelles réformes (partie 1) et devrait aussi connaître de nouvelles jurisprudences marquantes (partie 2).

I. LES REFORMES LEGISLATIVES ATTENDUES EN 2018

1. La révision de la Directive dite « e-privacy » et sa transformation en règlement

Qu’est-ce que la Directive e-privacy ? Quel est son champ d’application ? Pourquoi co-existe-elle aux côtés de la directive 95/46 qui va être remplacée par le RGPD ?

La Directive 2002/58/CE du Parlement européen et du Conseil du 12 juillet 2002 concerne le traitement des données à caractère personnel et la protection de la vie privée dans le secteur des communications électroniques. Cette directive vise aussi le secteur des communications numériques alors que le RGPD est indifférent quant à la forme de la communication, son objet englobant tous traitements de données à caractère personnel visés à travers son champ d’application. C’est donc une lex specialis par rapport au RGPD, même si ce point a fait l’objet de discussions techniques.

Pourquoi cette réforme ?

La Commission a lancé ce chantier dans l’espoir d’une adoption en mai 2018 et d’une réforme concomitante RGPD / E-privacy. Avec le souci de renforcer le marché unique numérique et la confiance lors de l’utilisation des services numériques via une protection accrue des données personnelles.

En effet, depuis la dernière révision de la directive E-privacy en 2009, de très nombreuses évolutions technologiques ont bouleversé ce domaine, notamment dans le secteur des télécommunications avec l’apparition de nouveaux acteurs tels que Skype, Whatsapp, Facebook Messenger qui renouvellent la manière de communiquer grâce à la technique de la VOIP. (« Voix sur IP » [tiré de l’anglais Voice over IP] : manière de communiquer par la voix, sur des réseaux compatibles IP).

L’objectif de la Commission est également d’utiliser dans la mesure du possible des « définitions neutres » d’un point de vue technologique afin d’englober les nouveaux services et technologies et d’assurer la pérennité du règlement (p.10), en dépit de la difficulté d’un tel exercice. [1]

Le calendrier

La proposition de règlement concernant le respect de la vie privée et la protection des données à caractère personnel dans les communications électroniques et abrogeant la directive 2002/58/CE (règlement « vie privée et communications électroniques »), a été dévoilée le 10 janvier 2017. [2] En dépit du souhait initial de la Commission d’une adoption le 25 mai 2018, ce calendrier ambitieux ne pourra être atteint, au vu des nombreux points encore ouverts.

Quels sont les points clés de la réforme ?

L’un des objectifs premiers est d’atteindre les fournisseurs de services OTT

Les fournisseurs de services OTT (« Over the Top ») sont les nouveaux géants d’Internet et dominent largement le secteur des télécommunications, comme Whatsapp, Skype, Facebook messenger... Cette réforme prévoit une extension du champ d’application du règlement à ces nouveaux acteurs [3] et notamment que les OTT seront tenus de respecter la confidentialité des communications et les droits fondamentaux des utilisateurs conformément à la Charte.

Mieux encadrer les cookies

La Commission souhaite clarifier la règlementation sur les cookies afin de donner davantage de pouvoir aux utilisateurs de services de communication en ligne, à travers un renforcement des règles de consentement. Ainsi, les cookies-tiers qui pistent la vie privée des internautes pourraient être bloqués [4] tout en conférant aux utilisateurs un pouvoir de modulation en ce qui concerne le choix des cookies qu’ils souhaitent accepter ou non.

Renforcement du consentement des utilisateurs

Le renforcement du consentement des individus est au cœur de la réforme. En effet, la Commission souhaite imposer aux opérateurs, des mesures concrètes afin de donner les « pleins pouvoirs » aux utilisateurs. Les considérants de la proposition de règlement (qui pour rappel n’ont pas de valeur juridique) éclairent sur les mesures qui pourraient être mises en œuvre :

L’utilisateur, pourrait, par exemple, désormais choisir à « la carte » les cookies qu’il souhaite accepter sur son navigateur ; « Les utilisateurs finaux devraient disposer d'un éventail de réglages de confidentialité́, depuis les plus restrictifs (par exemple, «ne jamais accepter les cookies») jusqu'aux plus permissifs (par exemple, «toujours accepter les cookies»), en passant par des options intermédiaires (par exemple, «rejeter les cookies de tiers» ou «accepter uniquement les cookies propres»). Ces paramètres de confidentialité́ devraient se présenter sous une forme facile à visualiser et à comprendre ». [5]

Par exemple, au considérant 24 « Les navigateurs Web sont encouragés à proposer aux utilisateurs finaux des moyens faciles de modifier leurs paramètres de confidentialité à tout moment en cours d'utilisation et à leur permettre de prévoir des exceptions ou d'établir une liste blanche de certains sites Web ou de préciser les sites Web dont ils acceptent toujours ou n'acceptent jamais les cookies (de tiers) ». [6]

Si le bilan de cette réforme est ambitieux - renforcer la protection de la vie privée et des données personnelles dans le cadre d’un dispositif européen intégré – cette dernière reste encore soumise à de nombreuses interrogations quant à son calendrier et à l’issue des travaux législatifs.

2. La transposition de la directive « police-justice » du paquet protection des données

La transposition à venir de la directive adoptée en même temps que le RGPD ne doit pas être négligée.

En effet, la réforme du droit des données personnelles est un « paquet » et la directive (UE) (2016/680) du Parlement européen et du Conseil du 27 avril 2016 relative à la protection des personnes physiques à l'égard du traitement des données à caractère personnel par les autorités compétentes à des fins de prévention et de détection des infractions pénales, d'enquêtes et de poursuites en la matière ou d'exécution de sanctions pénales, et à la libre circulation de ces données devra être transposée dans les ordres juridiques des différents États-membres, au plus tard, le 6 mai 2018. Le projet d’adaptation de la LIL comprend des dispositions spécifiques, le Sénat devant débuter ses travaux en mars prochain dans le cadre de la procédure accélérée.

3. La transposition de la directive NIS : Network and Information Security

La Directive NIS Directive (UE) 2016/1148 du Parlement européen et du Conseil du 6 juillet 2016 concernant des mesures destinées à assurer un niveau élevé commun de sécurité des réseaux et des systèmes d'information dans l'Union vient d’être transposée en droit français le 15 février dernier . http://www.senat.fr/dossier-legislatif/pjl17-105.html

Cette directive doit être signalée alors que les préoccupations dans le domaine de la cyber-sécurité sont de plus en plus importantes.

II. LES JURISPRUDENCES ATTENDUES EN 2018

De nombreuses affaires sont actuellement pendantes.

Nous signalons certaines de ces affaires qui touchent non seulement à la protection des données personnelles, mais également de manière transversale, au droit international privé, au droit de la consommation et au droit pénal. A ce titre, les solutions qui seront retenues dans les affaires suivantes présenteront un intérêt particulier pour ces matières :

- Microsoft contre Irlande ;

- Affaire « Origine du Monde » ;

- M. Schrems ;

- La question prioritaire de constitutionnalité concernant l’accès à une clef privée de chiffrement par les autorités françaises

1. L’affaire Microsoft c/ Ireland

Pour rappel, il est question dans cette affaire de la possibilité, pour les autorités américaines, d’avoir accès à des emails hébergés à l’étranger, et notamment en Irlande. Les États-Unis, en vertu de leur loi « SCA » Store Communications Act avaient délivré un mandat à l’encontre de Microsoft, leur enjoignant la fourniture de ces informations. En vertu de la SCA, les autorités répressives américaines peuvent en effet contraindre des fournisseurs de messageries électroniques à procéder à la perquisition, au recueil et à la reproduction de communications électroniques, à plus forte raison dans le cadre du recours au cloud computing.

Microsoft, a cependant refusé de se conformer à ce mandat au motif qu’un mandat de perquisition émis par un juge américain ne pouvait pas produire d’effets en dehors des Etats-Unis et en l’occurrence en Europe.

Cette affaire aborde ainsi des questions sensibles au regard de la protection de la vie privée, de l’application extra-territoriale d’une loi et de l’accès à des informations stockées dans des réseaux en nuage. La Cour d’appel fédérale de Manhattan dans une décision rendue le 14 juillet 2016 a donné raison à Microsoft en énonçant que la portée extraterritoriale d’un mandat devait être prévue explicitement par la loi et que ce n’était pas le cas en l’espèce.

Après les premières décisions de tribunal rendues en faveur de Microsoft, le Département américain de la Justice a décidé de saisir la Cour suprême américaine dont la décision devrait intervenir en juin 2018. Cette procédure a donné lieu à une trentaine d’amicus curiae (intervention volontaire qui permet de faire part de son point de vue devant la Cour suprême, lorsque des enjeux juridiques et sociaux sont importants). La liste des différents amicus curiae est disponible sur le blog de la Cour Suprême américaine http://www.scotusblog.com/case-files/cases/united-states-v-microsoft-corp/

Deux mémoires sont notables :

- D’une part le mémoire de l’association des barreaux européens [7] : qui souhaite alerter sur les enjeux du secret des correspondances entre un avocat et son client En substance, le Conseil des barreaux européens a rédigé un mémoire en soutien à la société Microsoft et dénonce une décision qui pourrait étendre considérablement la capacité du gouvernement américain à se saisir de communications électroniques situées en dehors des USA ».

Dès lors, le CCBE met en avant le risque pour la protection de la vie privée des européens et le droit à la confidentialité des avocats dans leurs correspondances avec leurs clients. Il rappelle que le secret professionnel, et l’inviolabilité des communications avec l’avocat est une condition préalable et indispensable au procès équitable.

- D’autre part, le mémoire de la Commission européenne [8] qui souhaite s’assurer de la bonne compréhension par la Cour suprême de la législation européenne concernant la protection des données personnelles à la veille de l’entrée en application du RGPD. L’amicus curiae de la Commission européenne est « in support of neither party », la Commission européenne n’apportant son soutien ni aux Etats-Unis ni à Microsoft.

Pour rappel, l’Union européenne signale qu’elle fixe des limites strictes aux transferts hors de l’Union européenne grâce à 3 mécanismes (les transferts sur décision d’adéquation, les transferts grâce à des mécanismes appropriés, les transferts fondés sur des règles d’entreprises contraignantes) et souligne que c’est donc un niveau élevé de protection des données que doivent respecter les pays tiers s’ils souhaitent traiter des données relevant du champ d’application du RGPD.

2. L’affaire « Origine du monde » contre Facebook, Cour d’appel de Paris du 16 février 2016

L’affaire dite « Origine du Monde » contre Facebook est une affaire qui soulève des enjeux en matière de protection des consommateurs sur le réseau social Facebook. [9] À l’origine de cette affaire, un professeur de l’éducation nationale avait posté sur son « mur » (page personnelle) un célèbre tableau du peintre Courbet « l’Origine du Monde ». Le compte du professeur a été suspendu en raison de la violation par ce dernier des conditions générales d’utilisation du réseau social, le tableau étant considéré comme pornographique selon Facebook.

Ce professeur a souhaité contester cette décision pour atteinte à la liberté d’expression, alors que Facebook estimait que les juridictions françaises n’étaient pas compétentes, au vu de ses conditions générales d’utilisation du réseau social prévoyant une clause attributive de juridiction au profit de la juridiction de Santa Clara aux États-Unis.

Dans ce litige, la Cour d’appel de Paris a notamment relevé que ce professeur était bien un consommateur et décidé d’appliquer les règles du droit de la consommation, notamment les dispositions de l’article L. 132-1 du code de la consommation (ancien article applicable en l’espèce) sur les clauses abusives. La Cour a relevé que cette clause insérée dans les conditions générales d’utilisations de Facebook avait pour objet de supprimer ou entraver l’exercice d’actions en justice ou des voies de recours par le consommateur » (article R. 132-2 du code de la consommation). Ainsi :« Que dès lors, la clause attributive de compétence au profit des juridictions californiennes contenue dans le contrat a pour effet de créer, au détriment du non-professionnel ou du consommateur, un déséquilibre significatif entre les droits et obligations des parties au contrat ; qu’elle a également pour effet de créer une entrave sérieuse pour un utilisateur français à l’exercice de son action en justice (…) Considérant que l’ordonnance déférée sera dans ces conditions confirmée en ce qu’elle a déclaré la clause attributive du contrat abusive et réputée non écrite et retenu la compétence du tribunal de grande instance de Paris pour statuer sur le litige opposant M.X à la société Facebook Inc »

A suivre avec la décision de la Cour de Cassation sur ce dossier...

3. Schrems et les futures actions de groupe en matière de données personnelles ?

Comme nous l’écrivions dans notre précédent article, M. Schrems avait posé une question préjudicielle à la Cour de justice de l’Union européenne aux fins de savoir dans quelle mesure il pouvait engager une action de groupe à l’encontre de Facebook.

Le 25 janvier dernier, la Cour a relevé que M. Schrems pouvait, pour son compte engager une action de groupe devant les juridictions de son domicile, peu important son activité commerciale postérieure mais qu’en revanche, il ne le pouvait pas, en tant que cessionnaire des droits d’autres consommateurs.

L’actualité de ce sujet présente un intérêt particulier au regard du droit français, puisque a été adopté par l’Assemblée nationale, le 8 février dernier, l’amendement pour une action de groupe collective en matière de données personnelles.

En effet, le nouvel article 43 ter de la loi LIL 3, précédemment modifié par l’article 91 de la loi du 18 novembre 2016 relative à la modernisation de la justice du XXIème siècle, a ouvert la possibilité d’une action de groupe ayant subi un dommage causé par un manquement à la LIL. Cette loi a anticipé en partie les dispositions du RGPD qui concernent les voies de recours, responsabilité et sanctions (Voir les articles 77 à 84).

L’article 80 du RGPD prévoyait en effet la possibilité pour les personnes « le droit de mandater un organisme, une organisation ou une association à but non lucratif, qui a été valablement constitué conformément au droit d’un État membre, dont les objectifs statutaires sont d’intérêt public et qui est actif dans le domaine de la protection des droits et libertés des personnes concernées dans le cadre de la protection des données à caractère personnel les concernant, pour qu'il introduise une réclamation en son nom, exerce en son nom les droits visés aux articles 77, 78 et 79 et exerce en son nom le droit d'obtenir réparation visé à l'article 82 lorsque le droit d'un État membre le prévoit».

Cet article sera ainsi modifié :

1° Le III est remplacé par un alinéa ainsi rédigé :

« Cette action peut être exercée en vue soit de la cessation du manquement mentionné au deuxième alinéa, soit de l’engagement de la responsabilité de la personne ayant causé le dommage afin d’obtenir la réparation des préjudices matériels et moraux subis, soit de ces deux fins. » ;

2° Le IV est complété par un alinéa ainsi rédigé :

« Lorsque l’action tend à la réparation des préjudices subis, elle s’exerce dans le cadre de la procédure individuelle de réparation définie au chapitre Ier du titre V de la loi n° 2016‑1547 du 18 novembre 2016 de modernisation de la justice du XXIe siècle. »

Cette nouvelle disposition va donc plus loin, et permet non seulement la cession du manquement mais également la possibilité de demander une répartition des préjudices matériels et moraux subis (v. l’article 82 du RGPD « droit à la réparation et responsabilité »).

C’est un avertissement envoyé aux acteurs du web qui devront désormais prendre les mesures nécessaires afin de respecter la législation sur les données personnelles.

Les discussions législatives vont se poursuivre en mars prochain au Sénat. A suivre donc en particulier sur ce point.

4. Un personne suspectée d’avoir commis une infraction doit-elle fournir sa clé de déchiffrement ? Le Conseil constitutionnel va trancher

Le 10 janvier dernier [10], la Cour de cassation a posé une question prioritaire de constitutionnalité au Conseil constitutionnel à ce sujet.

Les faits de l’espèce concernaient les dispositions de l’article 434-15-2 du code pénal qui dispose que : « Est puni de trois ans d'emprisonnement et de 270 000 € d'amende le fait, pour quiconque ayant connaissance de la convention secrète de déchiffrement d'un moyen de cryptologie susceptible d'avoir été utilisé pour préparer, faciliter ou commettre un crime ou un délit, de refuser de remettre ladite convention aux autorités judiciaires ou de la mettre en œuvre, sur les réquisitions de ces autorités délivrées en application des titres II et III du livre Ier du code de procédure pénale.

Si le refus est opposé alors que la remise ou la mise en œuvre de la convention aurait permis d'éviter la commission d'un crime ou d'un délit ou d'en limiter les effets, la peine est portée à cinq ans d'emprisonnement et à 450 000 € d'amende. »

Ainsi, une personne suspectée dans le cadre d’une procédure pénale, serait tenue, en vertu de ce texte, sous peine de sanctions, de transmettre aux enquêtes la convention secrète de déchiffrement (les clefs de chiffrement étant utilisées pour protéger des communications privées, que ce soit pour protéger des mails, des échanges par SMS, des échanges sur des réseaux sociaux, etc).

La question posée au Conseil constitutionnel est la suivante : les dispositions de l’article 434-15-2 du code pénal « sont-elles contraires au principe du droit au procès équitable prévu par l’article 16 de la Déclaration des Droits de l’homme et du Citoyen du 26 août 1789, au principe de la présomption d’innocence, duquel découle droit de ne pas s’auto-incriminer et le droit de se taire, prévu à l’article 9 de la Déclaration des Droits de l’Homme et du Citoyen du 26 août 1789 ?"

Nous reviendrons plus tard sur cette affaire et ses conséquences.

Références

[1] Page 10 de la Proposition du Parlement européen et du Conseil sur la réforme e-privacy

http://eur-lex.europa.eu/legal-content/FR/TXT/HTML/?uri=CELEX:52017PC0010&from=EN

[2] http://eur-lex.europa.eu/legal-content/FR/TXT/HTML/?uri=CELEX:52017PC0010&from=EN

[3] Page 5 de la Proposition du Parlement européen et du Conseil sur la réforme e-privacy

http://eur-lex.europa.eu/legal-content/FR/TXT/HTML/?uri=CELEX:52017PC0010&from=EN

[4] Voir le Considérant 23 et article 8 de la Proposition du Parlement européen et du Conseil sur la réforme e-privacy

[10] https://www.courdecassation.fr/jurisprudence_2/qpc_3396/3478_10_38354.html

PROTECTION DES DONNEES PERSONNELLES: QUE RETENIR DE 2017?

L’année 2017 a été marquée par une actualité fournie en matière de protection des données personnelles. Nous vous présentons une sélection de ces différents événements marquants, notamment en matière de sécurité des données (1), les décisions à signaler de la Commission européenne et de la CNIL (2) ainsi que les dossiers en cours devant la Cour de justice de l’Union européenne (3).

I. Les atteintes à la sécurité des données

1/ Ransomwares

Les rançon-logiciels, (traduits de l’anglais : ransomwares) ont été au cœur de l’actualité en 2017 et parmi eux : Wannacry, Petya, NotPetya. Ceux-ci ont considérablement affecté les administrations, les hôpitaux [1], les entreprises [2], et les particuliers. Ces virus se sont transformés en véritables outils de prise d’otage numérique. Dernièrement, lors du Forum International de la Cybersécurité qui s’est déroulé à Lille, le 23 et 24 janvier 2018, le ministre de l'Intérieur Gérard Collomb a annoncé un plan de lutte contre les cyber-menaces avec la création de 800 postes consacrés à cette priorité : « Que l’on pense par exemple à Wannacry, cette cyberattaque mondiale ayant touché en mai dernier des institutions et des entreprises de 150 pays, parmi lesquels de grands constructeurs automobiles, des opérateurs téléphoniques, mais aussi des hôpitaux. Durant plusieurs heures, des usines ont été paralysées. Le préjudice subi s’évalue en centaines de millions de dollars. »

Toutefois, pour l’instant en France, en dépit de l’existence de dispositions pénales avec les articles 323-1 et 323-2 du Code Pénal (atteinte aux systèmes d’informations), les sanctions restent encore très faibles. La vigilance reste cependant essentielle dans ce domaine, au vu notamment de l’attention portée par la CNIL au niveau de sécurité apporté pour protéger les traitements de données personnelles.

2/ Failles de sécurité

Equifax est un fournisseur de données financières (notamment pour la solvabilité et les capacités de remboursement des personnes) qui a subi une faille de sécurité très importante au cours de l’année passée au cours de laquelle des pirates informatiques ont eu accès aux informations personnelles de plus de 140 millions d'Américains. Ainsi plusieurs centaines de millions d’américains ont été touchés par ce vol d’identité numérique qui concernait des données telles que le nom, prénom, numéro de carte de crédit, numéro de sécurité sociale...

Uber, a aussi annoncé par le biais de son nouveau directeur général, Dara Khosrowshahi dans un communiqué de novembre dernier le vol de données de 57 millions d’utilisateurs.

Ces deux affaires ont provoqué des réactions fortes, notamment au vu du manque de clarté et de transparence supposé de ces entreprises, bien au-delà des failles de sécurité.

Or il faut souligner dans ce domaine que le nouvel article 33 du RGPD vient opérer un changement en matière de violation de données personnelles. En effet, cette disposition oblige les opérateurs à notifier une violation de données à caractère personnel. « En cas de violation de données à caractère personnel, le responsable du traitement en notifie la violation en question à l'autorité de contrôle compétente conformément à l'article 55, dans les meilleurs délais et, si possible, 72 heures au plus tard après en avoir pris connaissance, à moins que la violation en question ne soit pas susceptible d'engendrer un risque pour les droits et libertés des personnes physiques. Lorsque la notification à l'autorité de contrôle n'a pas lieu dans les 72 heures, elle est accompagnée des motifs du retard ».

Cela signifie qu’à partir de mai 2018, les mesures prises par les entreprises, en réaction à une faille de sécurité seront scrutées à la loupe par les autorités de contrôle. Et les éventuelles mesures correctives -prises ou non – seront aussi analysées dans le cas de sanctions.

II. Les sanctions prises par la Commission européenne et la CNIL

Facebook et Google ont été condamnées par la Commission européenne sur le terrain du droit de la concurrence, droit qui ne paraît aujourd’hui ne plus pouvoir ignorer les enjeux liés aux données personnelles.

Le rachat de Whatsapp par Facebook : analyse au regard du droit de la concurrence et de la violation de l’obligation d’information :

Ce rachat de Whatsapp par Facebook a donné lieu à deux décisions, la première de la Commission européenne (1), la seconde, de la CNIL (2).

1/ La sanction par la Commission européenne du 16 mai 2016 pour fourniture d’informations dénaturées

La sanction par la Commission européenne [3] de Facebook repose sur plusieurs aspects.

En effet était en cause la possibilité d’interconnexion des utilisateurs de l’application Whatsapp et ceux de Facebook. « La Commission a constaté que, contrairement à ce qu'avait déclaré Facebook en 2014 dans le cadre de la procédure de contrôle des concentrations, la possibilité technique de mettre en correspondance les identités des utilisateurs de Facebook et de WhatsApp existait déjà cette année-là et que les employés de Facebook étaient au courant de cette possibilité ».

La Commission a évalué les risques pour la concurrence, au regard du Règlement européen sur le contrôle des concentrations n° 139/2004 du Conseil du 20 janvier 2004, dans l’hypothèse d’une absence d’interconnexion entre les deux services. Or, la Commission a relevé que « la possibilité technique de mettre en correspondance les identités des utilisateurs de Facebook et de WhatsApp existait déjà cette année-là et que les employés de Facebook étaient au courant de cette possibilité ». Et elle a de fait prononcé cette sanction.

Dans le cadre de cette sanction a aussi été évoquée en filigrane les enjeux de la constitution de bases de données personnelles particulièrement importantes et leurs effets sur la concurrence.

2/ Sanction de la CNIL à l’égard de Facebook pour manquements à la loi informatique et libertés

La formation restreinte de la CNIL a également prononcé, le 27 avril 2016, une sanction de 150.000 €, rendue publique, à l’encontre des sociétés Facebook INC et Facebook Ireland. Cette dernière a été prononcée en raison de nombreux manquements à la loi Informatique et Libertés et notamment sur des points importants concernant le consentement des personnes concernées et la collecte loyale des données personnelles (notamment en raison de l’utilisation du cookie DATR qui recueillaient également des informations sur les personnes non inscrites sur Facebook), le manquement au recueil du consentement des personnes concernées.

3/ Google : Sanction de la Commission européenne pour abus de position dominante

La Commission a également infligé à Google une amende de 2,42 milliards d’euros le 27 juin dernier pour abus de position dominante sur le marché des moteurs de recherche et pour avoir favorisé son propre service de comparaison de prix (4). Google aurait ainsi abusé de sa position dominante sur ce marché un conférant à son service de comparaison des prix un avantage illégal.

III. En cours: les affaires pendantes devant la Cour de justice de l’Union européenne

1/ Le droit à l’oubli :

Le droit à l’oubli numérique a été consacré de manière jurisprudentielle par la célèbre décision Google Spain du 13 mai 2014. Toutefois, la possibilité de retirer un contenu sur Internet existait déjà sous la LIL, par le mécanisme des articles 38 (droit d’opposition) et 40 (droit de suppression). Néanmoins, depuis sa consécration jurisprudentielle, de nombreuses questions pratiques persistent et ce droit se heurte à différents intérêts en présence et notamment : droit du public à l’information, liberté d’expression, sécurité juridique.... La Cour de justice, a également rappelé, à l’occasion d’une décision, CJUE, Cammera di Commercio c. M. Manni, du 9 mars 2017, que le droit à l’oubli n’était pas absolu et qu’il devait être mis en balance avec le principe de sécurité juridique des tiers.

Le Conseil d’État a, par ailleurs et à deux reprises, posé des questions préjudicielles à la Cour de justice de l’Union européenne qui restent pendantes :

D’une part, une première question préjudicielle du Conseil d’État du 24 février 2017, dans des affaires jointes n°391000, 393769, 399999, 401258, qui concernaient des données sensibles. Très brièvement, la première concernait un photomontage satirique mettant en scène la directrice du cabinet d’un maire, la deuxième un ancien responsable de l’église de Scientologie, la troisième une mise en examen qui concernait des hommes politiques et enfin la quatrième affaire pour des faits de pédophilie. La question concernait les obligations du moteur de recherche en cas de demande de déréférencement d’un tel contenu.

D’autre part, une seconde question préjudicielle du Conseil d’État du 19 juillet 2017, sur la portée territoriale des injonctions de déréférencement à l’encontre du moteur de recherche. La question concernait le champ d’application du déférencement au sujet duquel la CNIL a adopté une position claire dans son communiqué du 12 janvier 2017 : un déréférencement mondial. [5].

2/ M. Schrems

Maximilien Schrems est un étudiant autrichien qui s’est fait connaître par la célèbre affaire qui a mené à l’invalidation du « Safe Habor » concernant le transfert aux USA de certaines données personnelles et à son remplacement par le Privacy Shield. (CJUE, 6 octobre 2015) [6]

Courant 2017, ont été posées deux questions préjudicielles à la Cour de justice de l’Union européenne :

D’une part, une première question préjudicielle, concernait la qualité de « consommateur » de M. Schrems, individuellement, et ce, lorsque ce dernier est cessionnaire des actions de groupes d’autres consommateurs. Posée le 19 septembre 2016 [7] à la Cour de justice de l’Union européenne, cette dernière a statué le 25 janvier 2018.

La position retenue par la CJUE était intéressante à un double égard pour déterminer d’une part, si un «consommateur» perd cette qualité lorsque après avoir utilisé pendant relativement longtemps un compte Facebook privé, « pour faire valoir ses droits, il publie des livres, et donne parfois également des conférences rémunérées, exploite des sites Internet, collecte des dons afin de faire valoir les droits et se fait céder les droits de nombreux consommateurs en contrepartie de l’assurance de leur remettre le montant obtenu, après déduction des frais de justice, au cas où il obtiendrait gain de cause» et d’autre part si ce consommateur peut se prévaloir du tribunal du lieu de son domicile quand il devient cessionnaire des droits des autres consommateurs.

Ces questions étaient importantes au regard du droit international privé. En effet, l’article 18 du Règlement Bruxelles I bis pose une exception au principe selon lequel, la juridiction compétente est celle du tribunal du défendeur -afin de faciliter les démarches du consommateur- et permet à ce dernier de saisir le tribunal de son propre domicile. La Cour de justice, dans sa décision du 25 janvier 2018 dernier a indiqué que M. Max Schrems conservait sa qualité de consommateur et que peu importait son activité postérieure, qu’il pouvait ainsi engager une action contre Facebook Ireland en Autriche. En revanche, la CJUE a souligné qu’en tant que cessionnaire des droits des autres consommateurs, M. SCHREMS ne pouvait bénéficier de l’exception issue de l’article 18 du Règlement Bruxelles I bis et saisir le tribunal de son propre domicile aux fins d’une action collective.

Cette position est en lien direct avec l’actualité puisque a été adopté par l’Assemblée nationale, le 8 février dernier, un amendement pour une action de groupe collective en matière de données personnelles. [8]

D’autre part, une seconde question préjudicielle posée par la Haute Cour d’Irlande, [9] à propos d’une autre action Max Schrems concernait les clauses contractuelles types de Facebook.

Dans cette affaire, il était question de la validité des clauses contractuelles types de Facebook. Pour rappel, il existe un principe d’interdiction de transferts des données personnelles vers des pays tiers à l’Union européenne [10]. Ces transferts, sont toutefois autorisés, dans certains cas :

Le pays bénéficie d’une décision d’adéquation [11]

Un transfert fondé sur des garanties appropriées [12]

Ou encore, sur le fondement de règles d’entreprises contraignantes [13]

Etait ici en cause le mécanisme des clauses contractuelles mises en place par Facebook, qui selon M. Schrems ne garantissaient pas une protection suffisante, notamment en raison des programmes de surveillances américains. En effet, dans la décision rendue le 3 octobre 2017 par la Haute Cour Irlandaise [14], les autorités gouvernementales américaines, auraient, selon Max Schrems, un accès aux données personnelles d’européens du fait du programme PRISM.

En conclusion, il est notable que les questions relatives aux données personnelles ont occupé une part importante de l’actualité en 2017. Le RGPD, sujet inscrit à l'agenda des entreprises témoigne de la préoccupation grandissante pour ces aspects tandis que la CNIL, par son action de plus en plus visible incite également les personnes à se préoccuper de leurs données personnelles. Cet « empowerment » des individus sur le contrôle de leurs données est désormais consacré à l’article 1 de la LIL du fait des dispositions de la loi pour une République Numérique (« toute personne dispose du droit de décider et de contrôler les usages qui sont faits des données à caractère personnel la concernant »). Ce principe d’autodétermination informationnelle est ainsi la clef de voûte de la protection des données à caractère personnel avant même de finaliser l'adaptation du RGPD.

Dossier majeur de 2017, la protection des données personnelles devrait ainsi connaître une nouvelle actualité nourrie dans les mois à venir. Notre prochain article évoquera les décisions et événements attendus en 2018.

REFERENCES

[3] Délibération n°SAN – 2017-006 du 27 avril 2017 - Délibération de la formation restreinte SAN –

2017-006 du 27 Avril 2017 prononçant une sanction pécuniaire à l'encontre des sociétés FACEBOOK INC. et FACEBOOK IRELAND

[4] http://europa.eu/rapid/press-release_IP-17-1784_fr.htm

[5] https://www.cnil.fr/fr/pour-un-droit-au-dereferencement-mondial

[6] CJUE, 6 octobre 2015, C-362/14

[7] Affaire C-498/16: Demande de décision préjudicielle présentée par l’Oberster Gerichtshof (Autriche) le 19 septembre 2016 — Maximilian Schrems/Facebook Ireland Limited

[8] L’article 43 ter de la loi n° 78-17 du 6 janvier 1978 précitée est ainsi modifié :

1° Le III est remplacé par un alinéa ainsi rédigé :

« Cette action peut être exercée en vue soit de la cessation du manquement mentionné au deuxième alinéa, soit de l’engagement de la responsabilité de la personne ayant causé le dommage afin d’obtenir la réparation des préjudices matériels et moraux subis, soit de ces deux fins. » ;

2° Le IV est complété par un alinéa ainsi rédigé :

« Lorsque l’action tend à la réparation des préjudices subis, elle s’exerce dans le cadre de la procédure individuelle de réparation définie au chapitre Ier du titre V de la loi n° 2016-1547 du 18 novembre 2016 de modernisation de la justice du XXIe siècle. »

[9] The High Court Commercial [2016 No. 4809 P.] Between The Data Protection Commissioner Plaintiff And Facebook Ireland limited and Maximillian Schrems Defendants http://www.courts.ie/Judgments.nsf/09859e7a3f34669680256ef3004a27de/8131a5dde8baf9ff802581b70035c4ff?OpenDocument

[10] Article 44 du RGPD

[11] Article 45 du RGPD

[12] Article 46 du RGPD

[13] Article 47 du RGPD

[14] He states that there is clear evidence that leads him to believe that his personal data controlled by Facebook and processed by Facebook Inc. is at the very least “made available” to US government authorities under various known and unknown legal provisions and spy programmes such as the “PRISM” programme (which I explain more fully below). He also believes that there is a likelihood that his personal data has, in addition, been accessed under these provisions as he was prevented from boarding a transatlantic flight on the 16th of March, 2012, to the United States for reasons of “national security”. (page 35).

RGPD: Quelle adaptation en droit français? (2)

Le 14 décembre dernier, nous avons rédigé un premier article sur l’adaptation en droit français du RGPD et les risques liés à un calendrier si contraint, risques également soulignés par la CNIL dans son avis de décembre 2017 (1). En effet, alors que l’adoption de ce règlement européen ouvrait une fenêtre de tir pour une refonte du cadre juridique actuel, seule une première révision limitée aura lieu avant de procéder par ordonnance ultérieurement, ce qui ne permettra pas de disposer au 25 mai 2018 d’un régime consolidé et prévisible.

Par ailleurs, le caractère spécifique de ce processus d’adaptation doit être souligné, alors que les premiers travaux législatifs viennent de débuter en procédure accélérée. En effet, si le RGPD est un règlement (tel que défini par l’article 288 du traité sur le fonctionnement de l’Union européenne (TFUE) et donc directement applicable, sans besoin d’être transposé), ce texte laisse en pratique une marge de manœuvre aux Etats-membres (2) et prévoit 57 points spécifiques devant faire l’objet d’adaptation (et non de transposition), par exemple en matière de consentement des mineurs (3). Si ces dispositions traduisent le compromis politique trouvé à Bruxelles, elles risquent aussi de créer de nouvelles « fragmentations » dans le cadre juridique des données personnelles en cours de construction à l’échelle européenne. (4)

Cette adaptation sera complexe, du fait de sa nécessaire articulation avec la loi pour une République Numérique qui a anticipé de nombreux points du règlement. En effet, la France avait décidé de préempter l’entrée en application du RGPD (alors en cours de négociation) à travers certaines dispositions de la loi Pour une République Numérique, dite « Loi Lemaire », adoptée le 7 octobre 2016. (5) (le calendrier des différents décrets d’application est consultable ici.).

Au-delà des aspects problématiques d’une telle anticipation (au regard du principe de coopération loyale ou des compétences de l’Union européenne), cette loi a aussi repris certaines dispositions du RGPD en les adaptant. C’est le cas par exemple du droit à l’oubli avec la mise en œuvre d’une disposition spécifique pour les mineurs, insérée à l’article 40.II de la Loi informatique et libertés. (6). Or ce nouveau droit devra être analysé au regard du droit à l’oubli consacré à l’article 17 du RGPD et des préoccupations déjà exprimées par l’Assemblée nationale (7).

De la même façon, le droit à la portabilité - consacré dans la proposition initiale du RGPD- a été repris par la loi pour une République Numérique, ce droit s’inscrivant par ailleurs dans le cadre du Marché unique numérique (8) et du courant du Free flow of non-personal data. (9)

La Loi pour une République Numérique a limité le champ d’application du droit à la portabilité envisagé de façon sectorielle dans le code de la consommation, alors que le RGPD ne prévoyait pourtant pas de restriction et consacré un tel droit à la française à l’article L224-42-1 dans la version à venir à partir du 25 mai 2018 du code de la consommation (le consommateur dispose en toutes circonstances d'un droit de récupération de l'ensemble de ses données). Or la portée de cet article devra aussi être appréciée avec celles des dispositions du RGPD, directement applicables et générales.

Si l’adoption de certaines dispositions du RGPD a été anticipée par la loi pour une République numérique, ce règlement n’en constitue pas moins un chantier important au vu des changements induits et des défis qu’il suscite.

Notamment parce que le RGPD constitue une révolution du cadre juridique des données à caractère personnel, révolution soulignée à juste titre par le Conseil d’Etat.

En effet, le RGPD introduit un concept novateur en droit de la protection des données personnelles, avec la notion d’accountability qui renforce la responsabilisation des entreprises et des parties prenantes (10) et qui a de nombreuses conséquences (nomination d’un Data Protection Officer (11) par exemple.

De nouveaux outils sont également mis en place avec la tenue d’un registre des activités de traitement, (12) l’obligation de réalisation d’études d’impact (13) ou encore les obligations au titre des principes de privacy by design et by default (14).